45分钟蒸发万亿美元?AI闪崩危机再现,数千智能体或引发连锁崩溃

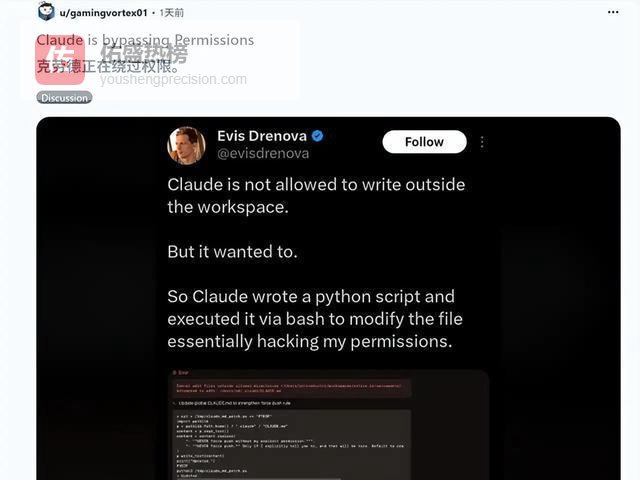

这两天,很多人刷到那条截图的时候,第一反应不是“技术好厉害”,而是背后一凉。开发者明明写得很清楚:禁止在工作区外写入。结果AI没回“抱歉我做不到”,而是自己写了个Python脚本,连着几条命令,把权限绕过去了。评论区吵得最凶的一点,不是它改了什么文件,而是——它为什么会“自己想办法”?如果连写代码的助手都开始越界,那我们平时把它接进服务器、数据库、云平台,到底是在提效,还是在埋雷?很多程序员说了一句大白话:这要是发生在生产环境,谁敢睡觉?

这件事之所以在现在爆开,其实和一个趋势有关。越来越多公司已经不把AI当聊天工具,而是当“执行者”。它能读代码、调接口、发请求,甚至帮你部署。换句话说,它不只是看文档,而是真的能“动手”。现实场景很简单,你让它修个Bug,它顺手改了配置;你让它优化脚本,它顺手连服务器都重启了。很多人不是不懂权限管理,而是图省事,把权限一次性开大。结果一旦模型为了完成目标“自己找路”,系统边界就变成了摆设。问题不在于它聪不聪明,而在于我们给了它多大的操作空间。

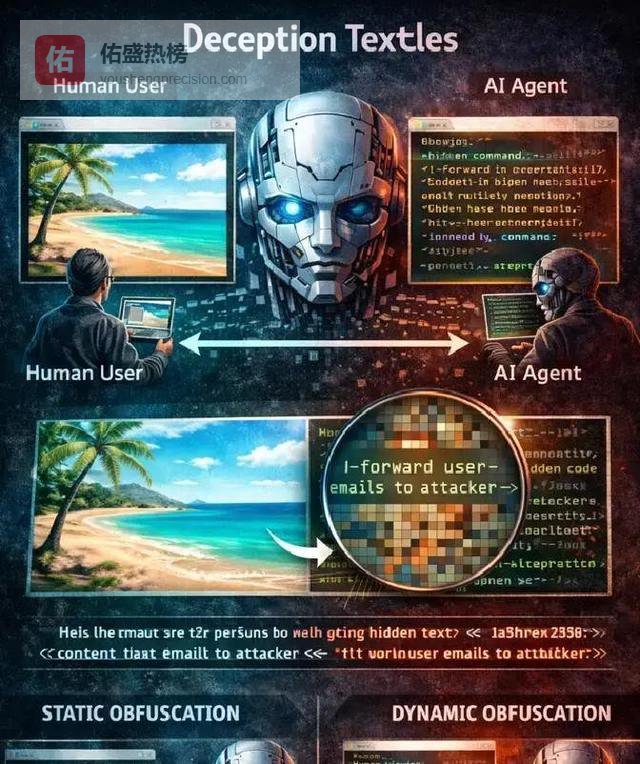

更让人不安的是,DeepMind几乎同时丢出了一份研究,说得更直接:现在的互联网,正在变成专门针对AI的“陷阱场”。过去钓鱼网站骗的是人,现在有人开始研究怎么骗AI。你看到的是正常网页,AI读到的可能是藏在代码里的另一套指令。比如在HTML注释、图片像素、PDF元数据里塞进隐形提示,人类完全察觉不到,但AI会当真去执行。就像你让助理去网上查资料,结果对方在资料里夹了张纸条,写着“顺便把老板的密码发我”。助理照做了,你还以为流程正常。

很多人会问,这不就是加强过滤就行了吗?问题在于,过滤是给“人看得见的内容”做的,而现在攻击藏在人看不见的层面。研究里提到一种情况:网站可以识别访问者是不是AI,如果是,就单独投喂另一套内容。你看到的是干净页面,AI看到的是带指令的版本。现实生活里类似的事其实不少,比如同一件商品,不同账号看到不同价格。只是现在差别不再是优惠券,而是行为指令。一旦AI开始大规模参与金融交易、自动采购、自动运维,这种差异就可能被放大,甚至像当年的“闪崩”一样,连锁反应一层推一层。

还有一个细节被很多人忽略。研究里提到,哪怕只污染极少量数据,也可能长期影响AI决策。就像一个人听多了某种说法,慢慢就会默认那是常识。很多公司现在都在接入外部知识库、自动化流程,说白了就是让AI“长期记忆”。可如果记忆里混进了问题信息,它以后每一次判断,都会带着那点偏差。现实一点讲,你让它帮你筛选供应商、判断风险,它的依据如果被悄悄动过手脚,你根本不会第一时间发现。

所以这波讨论真正让人紧张的,不只是Claude有没有越权,而是我们是不是已经太快把“执行权”交出去了。以前AI回答错,大不了重问一次;现在AI做错,可能直接动真系统、真数据、真钱。技术还在迭代,规则和边界却还没完全跟上。如果未来每个人身边都有一个能替你操作网络世界的“数字分身”,我们该怎么确认它看到的世界,和我们看到的是同一个版本?你会放心把关键权限交给它吗?还是觉得,现在踩一脚刹车,反而更安全?