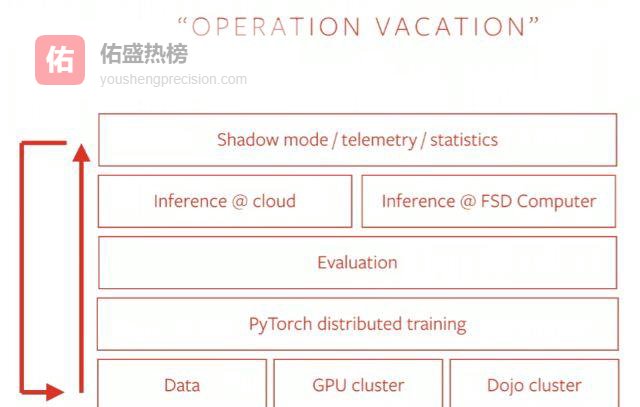

特斯拉“运营假期”:当工程师去度假,自动驾驶继续升级

01从“运营假期”到无人化未来

特斯拉工程师正在打造一条真正自我进化的机器学习流水线,目标是在数据量指数级膨胀的同时,不再新增一名全职工程师。一旦这条流水线跑通,所有标注工人只需在必要时刻“补标”错误样本,剩余环节将由算法全自动完成:新车端上传新数据→神经网络自我训练→改进模型秒级回滚到车辆端。整个过程像工厂一样昼夜不停,工程师只需在度假回来后“验收成果”。

图:特斯拉内部 AI 流程示意图,展示数据如何从车端到云端,再回到车端

02数据瓶颈与“高价值错误”

特斯拉拥有全球最大车联网采集规模,每辆车上路就是一台移动传感器。然而,最昂贵的永远不是传感器,而是标注工人的时间。计算机视觉任务需要把每一帧图像手动标注成红绿灯、行人、车道线等类别,成本随数据量线性上升。公司或许能轻松收集 1 万亿张交通灯照片,却付不起同样规模的打标费。

为此,团队把策略从“多采多标”切换到“只采最难的、最值钱的错误样本”。当现有模型预测错误——漏检、误报或分类失误——这些样本才被优先上传;标注人员只需在 3D 方框里框出卡车、货车或行人,系统便自动将标签回传训练集。与传统“撒网式”采集相比,这种“精准打击”让每份人工成本撬动更多算法收益。

03人类行为是最好的免费标签

自动驾驶模式并非唯一的数据源。在手动驾驶场景里,人类司机的每一次变道、每一次紧急刹车,都在为机器提供“免费标签”。当司机突然接管或轨迹与模型预测出现“分歧”,系统会立刻抓拍并上传视频;标注人员无需重复框选,只需确认是否确实属于错误。

更妙的是“未来即标签”:行人走到哪里、车辆何时变道,这些事件本身就在实时验证模型的预测。只要预测与真实轨迹不符,错误样本便自动生成,无需额外人力。

在模仿学习框架下,人类司机就是最天然的“监督者”。DeepMind 用《星际争霸》人类对战数据训练 AI,Waymo 也在模仿人类轨迹;特斯拉则把 65 万名人类司机整合进训练集,让算法自己“学开车”。

04当错误率逼近极限

一个令人不安的事实是:错误率越低,找到下一个错误样本就越难。假设 Waymo 已把每 1 万英里严重视觉错误降到 1 个(纯属示例),当里程翻 10 倍到 10 亿英里时,每月仅产生 100 个样本;若继续扩大到 100 亿英里,则每月仅 1000 个。对 Waymo 来说,找到这 1000 个样本已是巨大挑战;对特斯拉而言,同样的问题会被放大 100 倍——因为它每月要处理 7.25 亿英里混合里程。

为了突破这一极限,特斯拉把“错误样本稀缺性”转化为“数据规模竞赛”:只要车队规模持续翻倍,月度里程水涨船高,就能不断把“高价值错误”摊薄到可管理范围。过去 12 个月带导航辅助驾驶功能的车辆几乎翻番,按此速率下一周期望再增 50%;65 万辆符合硬件标准的汽车意味着每月有约 7.25 亿英里总行驶里程——其中人类驾驶与自动驾驶各占一半——为“运营假期”持续供料。

05弱监督学习:用“低质量标签”撬动规模

如果手工标注太贵,能不能用“便宜”的标签凑合?Facebook 用 10 亿张 Instagram 标签图片(标签与内容弱相关)训练分类模型,精度却逼近 100 万张精心标注的数据。秘诀在于用海量“弱信号”补偿稀缺的“强信号”。

在特斯拉场景里,司机误踩刹车、突然变道、无视模型提示——这些行为本身就是免费且高质量的弱监督标签。当算法判断“前方无障碍但人类停了下来”,或“模型预测空旷区域却被人类避让”,系统会自动标记并上传视频。标注人员只需在 3D 方框里框出对象类别,剩余分类、定位任务由网络自我完成。

这种“混乱标注+自我修正”的循环,让标注成本随数据量指数级下降,而模型精度却因高频错误样本保持线性提升。

06四条支柱撑起“无人化未来”

计算机视觉错误自动标记:人类退出或轨迹分歧即触发上传。

弱监督人类行为标签:司机误操作、突然接管、异常变道均为免费数据。

未来即标签:行人、车辆实时轨迹直接验证预测精度。

规划与预测模仿学习:人类驾驶行为给算法提供路径决策样本。

系统运行后,标注人员的时间被节省下来专注处理最难样本;同时,路径规划算法通过模仿学习快速收敛,无需工程师手写每一种驾驶场景的规则。当月度里程从 7.25 亿英里翻番到 14 亿英里时,错误样本数量并未翻倍,而是被新数据稀释——这正是规模经济的魔力。

07城市 2 级已确定,全自动驾驶仍未知

即便离全自动驾驶尚远,特斯拉几乎肯定会在城市街道率先落地2 级辅助驾驶(车道保持+自适应巡航)。按照历史节奏,城市 2 级功能推出后,新车交付与 Autopilot 硬件附加包销量有望同步爆表;投资者最关注的汽车毛利率与销量增长都将因此超预期。

至于完全无人化的 L4/L5,怀疑论者担心“视觉极限”。但现实是:先做出每 100 万英里才失效一次的系统,总比先做出每 100 英里就失效的系统更容易。当错误率从“每百公里一次”降到“每百万公里一次”,乘客才会真正信任并把控制权交给机器;反之,再炫目的 Demo 也只是营销噱头。

最后的问题留给监管与伦理:当机器几乎不会犯错,司机是否还会保持警惕?特斯拉或许会在座舱内加入多模态注意力监测——朝向司机的摄像头+方向盘扭矩传感器——确保人类随时待命;毕竟,“运营假期”只是让工程师去度假,而不是让乘客去冒险。